WeTransfer, el servicio de transferencia de archivos, ha encendido una nueva controversia tras modificar discretamente sus términos de uso. El cambio incluía una cláusula que permitía a la empresa utilizar los archivos subidos por los usuarios para mejorar sistemas de inteligencia artificial, algo que muchos usuarios han interpretado como una puerta abierta a entrenar modelos sin consentimiento explícito ni compensación.

Aunque WeTransfer ha reaccionado eliminado esa parte de sus condiciones, el daño reputacional está hecho. La reacción pública ha sido inmediata y contundente, especialmente entre profesionales creativos que, durante años, han confiado en la plataforma por su enfoque en la privacidad y el respeto al usuario.

¿Qué cambió exactamente?

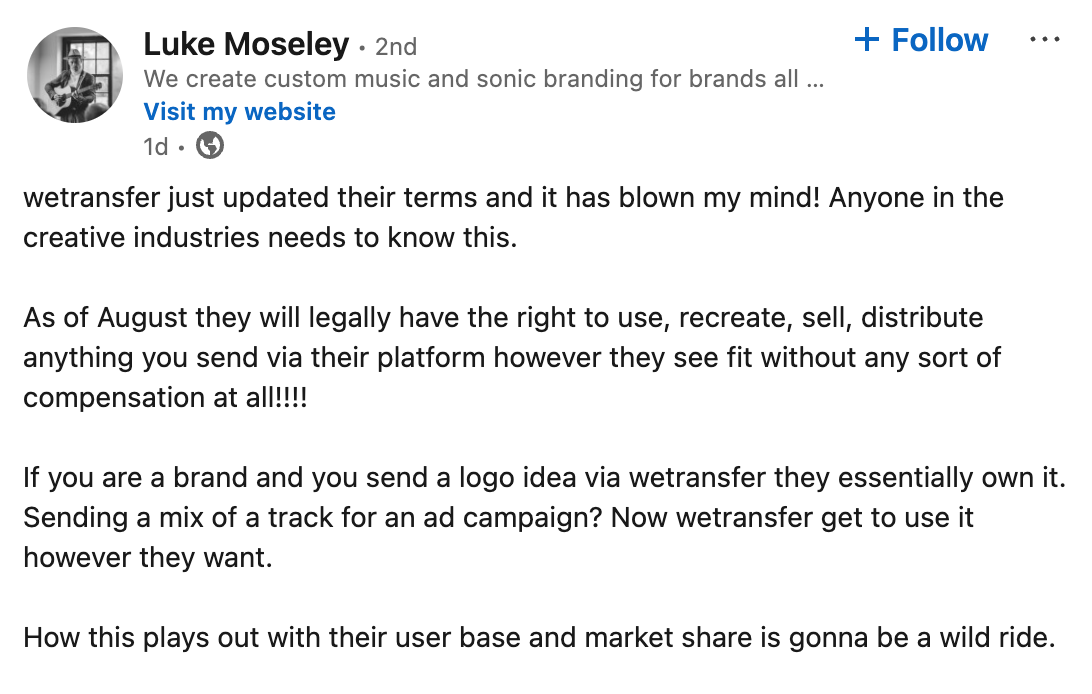

A partir del 8 de agosto, WeTransfer tenía previsto aplicar unos nuevos términos de servicio que otorgaban a la compañía una licencia perpetua y libre de derechos para usar el contenido subido por los usuarios. Esa licencia incluía expresamente la posibilidad de usar los archivos con fines de “mejorar modelos de machine learning destinados a la moderación de contenidos”.

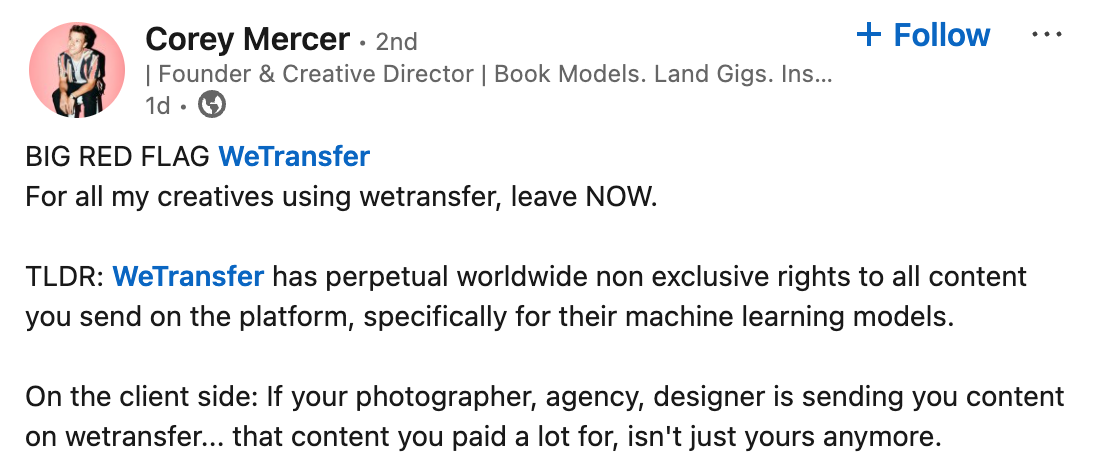

El lenguaje ambiguo del texto fue lo que generó la alarma. Figuras como la escritora de libros infantiles Sarah McIntyre o el comediante Matt Lieb expresaron públicamente su preocupación ante la posibilidad de que sus obras y su trabajo pudieran ser utilizadas -o incluso vendidas- para entrenar inteligencia artificial, sin haberlo autorizado ni recibido compensación alguna.

La respuesta de WeTransfer

La compañía reaccionó con rapidez publicando un comunicado para aclarar que no utiliza los archivos de los usuarios para entrenar IA, ni los vende ni los comparte con terceros. Según han explicado, simplemente habían considerado el uso futuro de inteligencia artificial para mejorar sistemas de moderación de contenido, pero esa tecnología “no ha sido desarrollada ni implementada”.

Wetransfer también actualizó sus términos de servicio, eliminando toda mención al machine learning. La nueva versión establece que los usuarios otorgan una licencia libre de regalías únicamente para mejorar el servicio. “A partir de vuestros comentarios, entendimos que podía no estar claro que conserváis la propiedad y el control de vuestro contenido. Hemos actualizado los términos para que sean más fáciles de entender. También eliminamos la mención al machine learning, ya que no es algo que WeTransfer utilice en relación con el contenido de los usuarios y pudo haber generado inquietud", explican desde la compañía en el comunicado emitido tras desatarse la crisis.

Sin embargo, para muchos usuarios, la confianza ya ha quedado tocada.

WeTransfer no es la primera empresa que genera controversia en este terreno. Zoom, Slack, Dropbox y otras compañías del entorno digital también han tenido que rectificar o aclarar públicamente sus políticas de uso de datos tras recibir críticas similares debido a la inquietud creciente sobre derechos de autor, consentimiento y control en la era de la inteligencia artificial.

En el caso de Wetransfer, el impacto ha sido especialmente sensible porque la empresa ha construido su imagen en torno a la privacidad y el respeto a los creadores. Por eso, el uso de un lenguaje vago y una licencia tan amplia ha sido visto por muchos como una traición a esos principios. Freelancers, artistas visuales y escritores han sido los primeros en expresar su indignación, preocupados ante la posibilidad de que sus trabajos acabaran siendo utilizados como material de entrenamiento para algoritmos.

Y aunque la compañía se ha disculpado públicamente en redes sociales como X (antes Twitter) muchos usuarios señalan que el movimiento les ha parecido un “globo sonda”: probar hasta dónde podían llegar con términos más permisivos, recibir una reacción negativa masiva y, finalmente, dar marcha atrás.

El resumen final de la empresa ante esta crisis, es el siguiente:

- SÍ - tu contenido siempre es tuyo

- SÍ - nos estás dando permiso para operar y mejorar el servicio de forma adecuada

- SÍ - nuestros términos cumplen con las leyes de privacidad, incluido el RGPD

- NO - no usamos tu contenido para entrenar modelos de IA

- NO - no vendemos tu contenido a terceros

Pero a medida que el desarrollo de la inteligencia artificial avanza, el dato del usuario se ha convertido en el nuevo combustible y la presión por acceder a grandes volúmenes de contenido para entrenar modelos está en pleno crecimiento. En este contexto, la relación entre usuarios y plataformas tecnológicas está cada vez más mediada por la sospecha, especialmente cuando se trata de contenido personal o creativo.